Les systèmes d’intelligence artificielle (IA), alimentés par des données massives & des algorithmes sophistiqués (entre autre), des réseaux de neurones profonds & l’apprentissage machine (machines à vecteur de support, clustering, forêts aléatoires, etc.) ont un impact profond sur notre vie quotidienne à mesure qu’ils se retrouvent dans tout ce qui nous entoure : de la finance aux soins de santé, du commerce au transport.

La recommandation de films de Netflix, la prédiction de produits d’Amazon, l’étonnante capacité de Facebook à montrer ce que vous pourriez aimer ou qui vous pourriez connaître, l’assistant de Google, AlphaGo de DeepMind, l’IA de Stanford battant les médecins humains…. Les algorithmes sont partout.

L’une des caractéristiques communes de ces puissants algorithmes est qu’ils utilisent des mathématiques sophistiquées pour faire leur travail : pour classer et segmenter une image, pour arriver aux décisions clés, pour faire une recommandation de produits, pour modéliser un phénomène complexe, ou pour extraire et visualiser un modèle caché d’une avalanche de données.

Tous ces processus mathématiques sont, tout simplement, au-delà de la portée d’un seul humain (ou même d’une équipe) : l’homme ne peut les effectuer manuellement, ni dans sa tête et ni même sur un ordinateur. C’est là que réside l’attrait des systèmes d’IA/Machine Learning : ils peuvent automatiser la tâche de raisonnement mathématique complexe à l’aide de modèles probabilistes et de règles statistiques lorsqu’ils sont associés à de nombreuses données brutes.

Cependant, nous verrons, dans cet article, que tous les types d’automatisation ne sont pas faciles pour les systèmes d’IA.

Automatisation du raisonnement vs. motricité

L’IA fonctionne à merveille avec les mathématiques. Au risque de le banaliser quelque peu, nous pouvons imaginer un système d’IA moderne comme un système de raisonnement mathématique automatisé. Et ça a toujours été ainsi, même dans le passé.

Dans les années 80 et 90, la logique symbolique – qui n’est rien d’autre qu’un paradigme de raisonnement mathématique sophistiqué – et les systèmes experts étaient en vogue. Avance rapide vers les années 2010 et 2020 et nous développons et utilisons des systèmes qui utilisent en base, de gigantesques solveurs d’algèbre linéaire et des modélisateurs de distribution statistique.

Nous sommes ainsi passés d’une approche basée sur les symboles (logique déductive) à une approche basée sur les données (généralisation inductive), mais le « dénominateur commun » n’a pas changé.

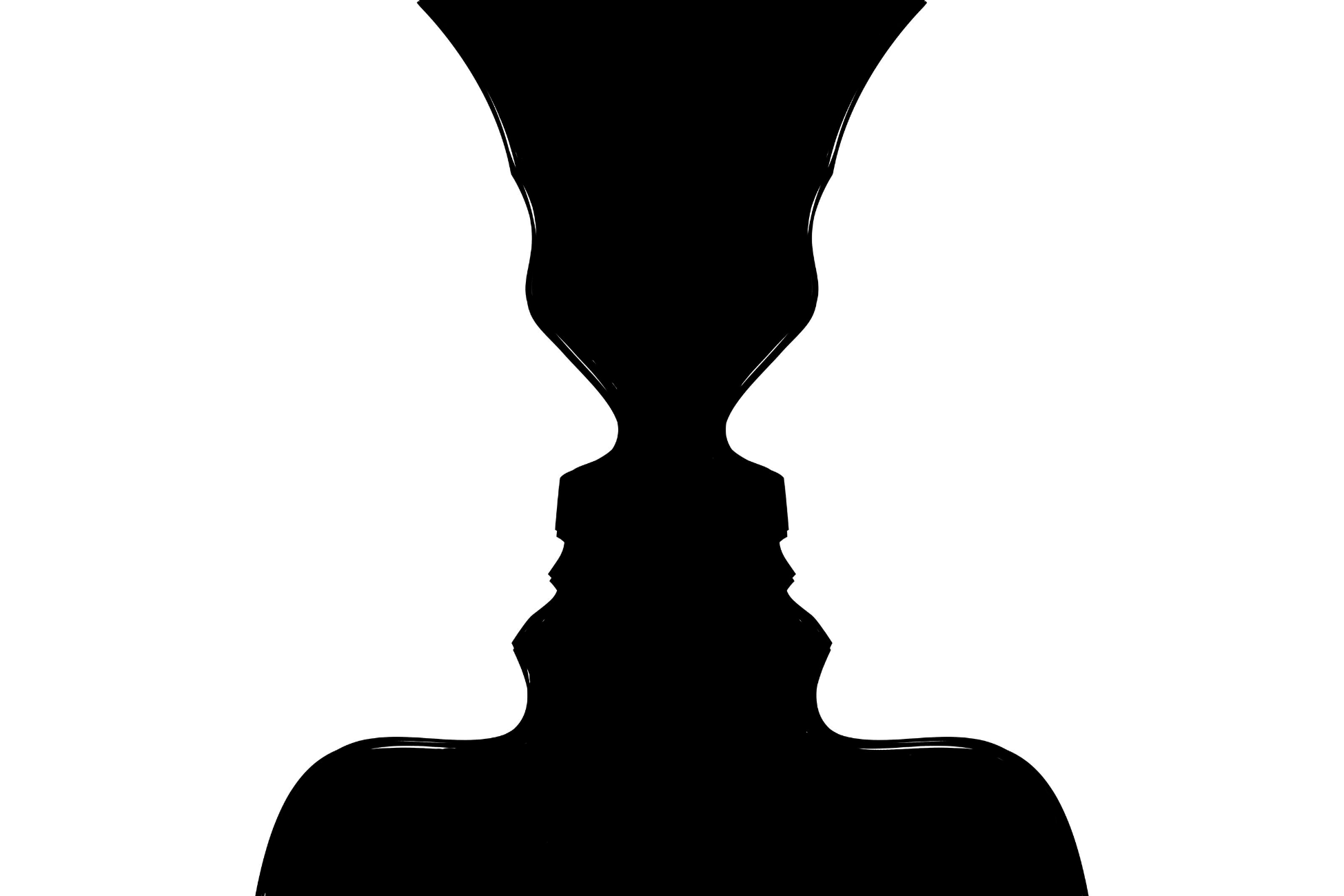

Qui est le plus intelligent : un jardinier ou un mathématicien ?

Cette question, bien sûr, est rhétorique et à la limite de l’offense. L’intelligence peut signifier différentes choses pour différentes personnes et il n’y a aucune raison de penser que les praticiens d’une profession donnée seront, même en moyenne, plus intelligents que les praticiens d’une autre profession. L’intelligence, après tout, est extrêmement délicate à définir.

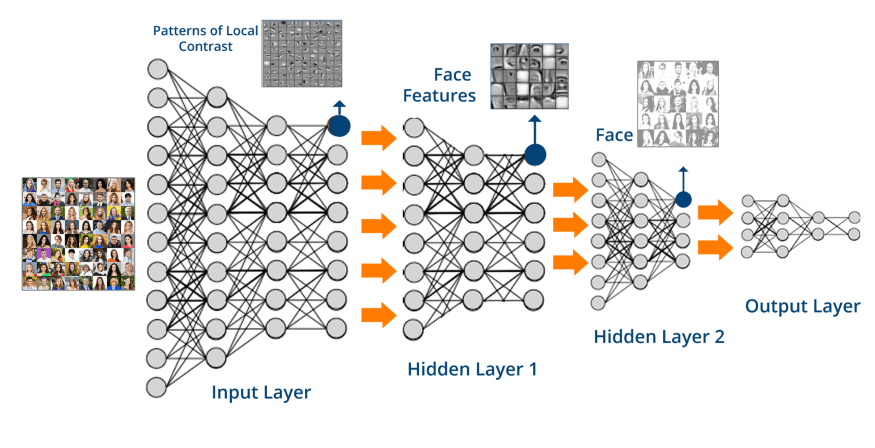

Reculons un peu et travaillons avec une définition plus restreinte de l’intelligence. Les systèmes d’IA d’aujourd’hui sont sans aucun doute des systèmes informatiques à grande échelle. La formation d’un système d’apprentissage en profondeur se produit à travers des centaines de passages répétitifs à travers des couches empilées de nœuds de calcul qui traitent de grandes quantités vectorisées.

Au niveau fondamental, cela se résume à des milliards de calculs simples – comme la multiplication ou l’addition ou le ET/OU logique. Par conséquent, dans un sens étroit, nous pouvons établir une équivalence entre le nombre de calculs et la capacité de raisonnement d’un système d’IA.

Nous avons vu cela passer d’un réseau de neurones à une seule couche cachée ne permettant pas de résoudre le problème du XOR à un ResNet à 152 couches pouvant classer des milliers de catégories d’images avec une grande précision. Plus de couches, plus de calculs, plus de puissance pour l’IA.

Source : www.michaelchimenti.com

Par conséquent, si nous associons le calcul à l’intelligence, c’est-à-dire la capacité à effectuer des calculs sophistiqués avec un degré d’intelligence plus élevé, alors un mathématicien prend le gâteau, n’est-ce pas ?

Au moins, nous pouvons en quelque sorte nous convaincre qu’une tâche de raisonnement mental de haut niveau nécessite beaucoup plus de calculs qu’un travail physique subalterne, comme le jardinage, que nous pouvons faire facilement sans effectuer de calculs compliqués dans notre tête.

Il s’avère que ce serait une mauvaise conclusion. Il est plus facile pour un système d’IA de devenir mathématicien que d’acquérir les compétences d’un jardinier. Du moins, pour les systèmes d’IA actuels, cela semble être le cas.

Le paradoxe de Moravec

Hans Moravec est un roboticien & informaticien américain d’origine autrichienne, et actuellement, membre du corps professoral adjoint de l’Institut de robotique de l’Université Carnegie Mellon. Il est connu pour ses travaux sur la robotique, l’intelligence artificielle et ses écrits sur l’impact de la technologie. Moravec est également un futuriste avec plusieurs de ses publications et prédictions axées sur le transhumanisme.

Dans les années 1980, Moravec, avec d’autres scientifiques pionniers tels que Marvin Minsky et Rodney Brooks, a fait une observation :

« il est relativement facile de faire en sorte que les ordinateurs présentent des performances de niveau adulte sur des tests d’intelligence ou de jeu de dames et difficile voire impossible de leur donner les compétences d’un enfant d’un an en matière de perception et de mobilité »

Bien que cette observation ait été faite il y a plus de 30 ans et que les modèles ResNet-50, qui ont démontré une capacité de perception au niveau humain dans le domaine étroit de la classification d’images, n’ont pas été développés à ce moment-là, la précision de l’observation est forte, encore à ce jour : avez vous déjà vu une équipe de robots de football face à une équipe de club amateur ? Ou bien un robot jardinier entièrement autonome qui peut tailler les feuilles, cueillir les fleurs assez et arroser le jardin sans faute ?

Contrairement aux hypothèses traditionnelles, le raisonnement (qui est une fonction dite de haut niveau chez l’homme) nécessite très peu de calcul, mais les compétences sensorimotrices (relativement faibles chez l’homme) nécessitent d’énormes ressources de calcul.

La base biologique des compétences humaines.

Toutes les compétences humaines sont mises en œuvre biologiquement, à l’aide de machines conçues par le processus de sélection naturelle. C’est aussi un processus qui accorde beaucoup de valeur à l’optimisation (de la dépense énergétique).

Pensez au cerveau humain : plus de 80 milliards de neurones se déclenchent dans ce processeur compact avec la facture d’électricité d’une seule ampoule faible (~ 20 watts). Une énorme quantité d’optimisation a été apportée pour faire de ces 1400 grammes le processeur écoénergétique ultime dans tout l’univers connu. Le développement des compétences humaines tout au long de l’évolution a donc eu tendance à préserver les améliorations de conception qui répondent à des critères d’optimisation extrêmement difficiles.

Mais ce processus d’optimisation est lent et nécessite beaucoup de temps pour façonner et guider l’évolution d’une compétence particulière. Il est donc simplement entendu que plus une compétence est ancienne, plus la sélection naturelle a eu du temps pour améliorer la conception.

La pensée abstraite et le raisonnement mathématique de haut niveau ne se sont développés que très récemment et, par conséquent, sa mise en œuvre et sa mécanique ne devraient pas être particulièrement efficaces.

Le raisonnement de haut niveau n’était pas un favori de l’évolution jusqu’à récemment.

Faites une pause et imaginez-vous être un homo sapiens debout dans la vaste savane africaine ou dans la forêt tropicale d’Amazonie, il y a 200 000 ans. Laquelle des compétences suivantes vous apprécierez le plus ?

- la capacité à courir plus vite pour s’éloigner d’une meute de hyènes

- la capacité à reconnaître et différencier une plante vénéneuse d’une plante médicinale

- la possibilité d’ajouter et de multiplier des nombres ou d’imaginer une belle histoire à raconter à vos tribus

La perception sensorielle et la motricité de notre espèce (liées aux mouvements musculaires) ont assuré sa survie tout au long de son histoire. Jusqu’à la soi-disant révolution cognitive il y a environ 70 000 ans.

Les analyses anthropologiques et les archives fossiles indiquent que c’est à ce moment là que notre espèce a développé la capacité de penser en termes de symboles et d’entités imaginaires.

Comme le souligne Yuval Harari dans son livre à succès Sapiens, la raison la plus importante de la domination de l’Homo Sapiens sur les autres espèces humanoïdes a été sa capacité à raisonner et à penser en termes abstraits et en entités imaginaires (par exemple, dieu, argent, nation, etc.).

La pensée abstraite et le raisonnement mathématique ont bien servi notre espèce. Langue, mathématiques, logique, art, science, technologie – tout découlait de cette capacité. Mais ce n’est qu’une évolution récente.

Pendant les centaines de millénaires avant cela, la motricité et la perception sensorielle avaient aidé à la survie et à l’alimentation de nos gènes. Seuls ceux qui avaient un réflexe supérieur et pouvaient repérer une menace prédatrice de loin, ou pouvaient courir plus vite et lancer avec un but sûr, ont survécu et ont transmis leurs gènes. Notre biologie a donc assuré que nous portons un processeur numérique sous-optimisé et un cortex moteur extrêmement efficace à l’intérieur de notre crâne.

Des activités beaucoup plus difficiles (pour l’IA) que de jouer aux échecs ou de faire des intégrales.

Moravec a fait valoir qu’en général, « nous devrions nous attendre à ce que la difficulté de la rétro-ingénierie de toute compétence humaine soit à peu près proportionnelle à la durée pendant laquelle cette compétence a évolué chez les animaux ».

Les compétences humaines les plus anciennes sont en grande partie inconscientes et elles nous semblent sans effort. Par conséquent, il ne devrait pas être surprenant que les compétences qui semblent sans effort, soient lourdes en calcul et difficiles à inverser par un système d’IA artificiel. Les compétences qui nécessitent un effort conscient – jouer aux échecs, faire des mathématiques, écrire de la poésie, jouer du piano, peindre une image – ne sont pas nécessairement difficiles à concevoir par l’IA.

Ainsi, le rythme du développement de la robotique du monde réel, de la perception visuelle et auditive, de la simulation des habiletés motrices, a été lent et extrêmement difficile. Ce n’est certainement pas la faute des professionnels et des chercheurs travaillant dans ces domaines : ces tâches ne sont tout simplement pas faciles à reproduire par une IA qui se concentre principalement sur le raisonnement mathématique et la résolution d’algèbre linéaire à grande échelle.

La preuve la plus solide ? Histoire de l’intelligence artificielle.

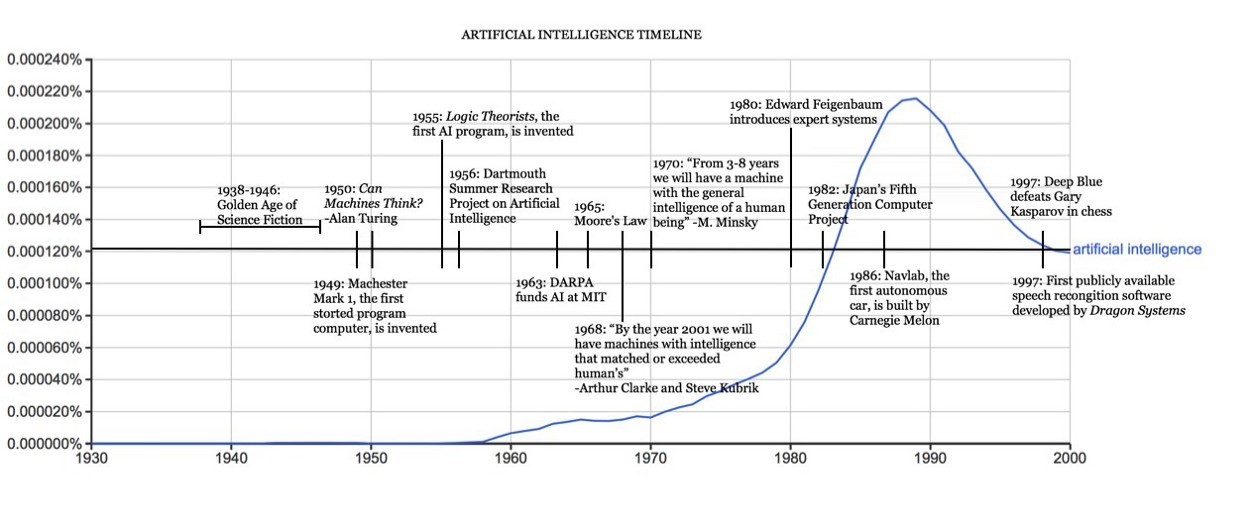

L’observation de Moravec n’est pas une loi physique. Cela ressemble peut-être davantage à la loi de Moore, qui est, après tout, une observation judicieuse. Certains appellent cela un paradoxe. Cependant, je pense que nous avons amplement la preuve de ce paradoxe rien que dans l’histoire du développement de l’IA.

Même aux débuts de l’IA et de l’informatique, les chercheurs avaient réussi à écrire des programmes qui prouvaient des théorèmes, résolvaient des problèmes d’algèbre et de géométrie et jouaient à des jeux comme les dames et les échecs. Et tout cela avec une puissance de calcul modeste et pratiquement aucune donnée.

Cela les a amenés à croire qu’une fois que ces problèmes « difficiles » sont complètement résolus par l’IA, les problèmes « faciles » tels que « reconnaître le visage d’un ami à partir d’une photo » ou « se déplacer dans un dortoir d’université sans basculer » devraient être du gâteau.

Comme le dit Rodney Brooks, les choses intelligentes étaient « mieux caractérisées comme les choses que les scientifiques masculins hautement qualifiés trouvaient difficiles » – les échecs, l’intégration symbolique, la démonstration de théorèmes mathématiques et la résolution de problèmes complexes d’algèbre textuelle.

« Les choses que les enfants de quatre ou cinq ans pouvaient faire sans effort, comme faire une distinction visuelle entre une tasse de café et une chaise, ou se promener sur deux jambes ou trouver leur chemin entre leur chambre et le salon, n’étaient pas considérées comme des activités nécessitant de l’intelligence ».

Ces problèmes prétendument « faciles » liés à la perception audiovisuelle et à la locomotion/mouvement se sont avérés être les plus difficiles à résoudre. Nous pouvons affirmer avec certitude que nous comprenons maintenant pourquoi il en est ainsi : c’est parce que la grande machinerie de l’évolution a également perfectionné et optimisé ces compétences chez notre espèce, plus dur et plus longtemps que toute autre chose.

La biologie, après tout, ne cédera pas si facilement à l’entreprise de l’intelligence artificielle.

AGI et emplois du futur

La simulation de la biologie est-elle la bonne voie vers l’Intelligence Générale Artificielle (AGI) ?

On pourrait soutenir que nous devrions peut-être construire nos systèmes d’IA en simulant les circuits du cerveau et concevoir les différents sous-processeurs imitant le travail de l’évolution. De cette façon, nous pourrions être en mesure d’allouer la bonne quantité de ressources informatiques aux bons sous-processeurs comme l’a fait l’évolution humaine.

La simulation du cerveau entier pourrait être une voie possible vers l’AGI. Il y a beaucoup de débats autour de sa faisabilité et de ses potentiels. Il existe d’ailleurs un projet passionnant pour simuler l’ensemble du cortex du cerveau humain. À l’heure actuelle, l’approche généralement acceptée consistant à créer un agent intelligent consiste à « imiter le comportement humain ». Cela équivaut au célèbre test de Turing où le critère pour qu’un agent de l’IA réussisse le test est seulement « d’apparaître comme un humain à un examinateur externe et de le forcer à le croire ».

Tant que nous concevons des systèmes d’IA selon ce principe, nous pourrions être, après tout, guidés par les limites placées par la biologie. Il nous faudra beaucoup plus de puissance de calcul et d’ingéniosité pour construire une IA qui imite les tâches de perception et de locomotion quotidiennes, que pour construire une IA, qui ne résout que les problèmes de raisonnement mathématique.

Les mathématiques sont faciles, le jardinage est vraiment difficile, finalement.

Conséquences sur les emplois du futur ?

On se demande donc quelles implications cela a pour les emplois du futur. Il y a beaucoup de spéculations sur le remplacement des emplois de col blanc par les technologies d’IA, tout comme la révolution industrielle a remplacé de nombreux emplois physiques ou la révolution automobile a rendu les voitures à chevaux obsolètes.

Alternativement, de nombreux experts ont proclamé un revirement et un avenir meilleur pour le marché du travail avec la soi-disant quatrième révolution industrielle qui est provoquée par l’automatisation de l’IA et de la robotique.

Quoi qu’il en soit, nous avons vu qu’il existe un argument scientifique solide pour croire qu’une multitude d’emplois impliquant des mouvements physiques complexes et une perception sensorielle subtile (par exemple, jardinage, coiffeurs, soins aux personnes âgées, garde d’enfants, sports, barman, hôtellerie) sont peu susceptibles d’être remplacés par une automatisation robotique de si tôt. Ces emplois dépendent en effet de compétences perfectionnées par des millions d’années d’optimisation des processus biologiques et nécessitent beaucoup plus de calculs que de nombreux emplois répétitifs de cols blancs qui ne dépendent que d’un raisonnement de haut niveau : produit récent de l’évolution humaine.